28 Şubat 2026 sabahı dünya, yeni bir çatışmanın değil, yeni bir savaş biçiminin doğuşuna tanıklık etti. ABD ve İsrail'in İran'a yönelik koordineli saldırıları — Operation Epic Fury ve Roaring Lion — sadece askeri bir operasyon değil, yapay zekanın büyük ölçekli bir savaşta ilk kez bu denli kritik rol oynadığı bir dönüm noktası. İlk 24 saatte 1.000'den fazla hedefin vurulması, binlerce drone'un Basra Körfezi'ne yayılması ve İran'ın internet altyapısının neredeyse tamamen çökertilmesi; tüm bunlar geleneksel savaş anlayışını kökünden sarsan teknolojik bir üçlüyü — yapay zeka, drone ve siber silahları — sahnenin merkezine taşıdı.

Yapay Zeka İlk Kez 1.000 Hedefi 24 Saatte Belirledi

ABD ordusunun İran operasyonunda yapay zekayı bu ölçekte kullanması, savaş tarihinde bir ilk. Bloomberg'in raporuna göre Pentagon, uydu görüntüleri, istihbarat verileri ve gözetleme bilgilerini işlemek için gelişmiş AI karar destek sistemlerinden yararlandı. Bu sistemler, devasa miktardaki veriyi gerçek zamanlı analiz ederek potansiyel hedefleri belirledi ve komutanlara öneriler sundu.

CBS News ve Washington Post'un kaynaklarına göre kullanılan AI modellerinden biri Anthropic'in Claude'uydu. Claude'un istihbarat değerlendirme, hedef tanımlama ve savaş senaryosu simülasyonlarında kullanıldığı belirtiliyor. Buradaki kritik ayrım şu: yapay zeka kendi başına ateş açma kararı vermiyor. Ancak bir insanın günlerce sürecek analiz sürecini dakikalara indirerek "karar destek" sağlıyor. Bu hız, ilk 24 saatte 1.000'den fazla hedefin vurulmasını mümkün kılan temel faktörlerden biri.

AI'ın savaştaki en büyük rolü şu anda hedef belirleme ve istihbarat analizi. Uydu fotoğraflarından askeri tesisleri tespit etmek, drone görüntülerinden hareketliliği takip etmek ve farklı istihbarat kaynaklarını çapraz doğrulamak — tüm bunlar AI'ın insandan kat kat hızlı yapabildiği görevler.

Anthropic'in "Kırmızı Çizgileri" ve Pentagon Çatışması

İşin en çarpıcı tarafı, Claude AI'ı geliştiren Anthropic ile Pentagon arasındaki gerilim. Anthropic CEO'su Dario Amodei, CBS News'e verdiği demeçte şirketin "Amerikan değerleriyle çelişen" kullanım senaryolarına karşı "kırmızı çizgiler" çekmeye çalıştığını açıkladı. Şirketin iki temel reddi vardı: kitlesel gözetim ve tam otonom silahlar.

Pentagon ise Claude'u "tüm yasal amaçlar" için kullanma hakkı talep etti. Uzlaşma sağlanamayınca Trump yönetimi Anthropic'i "Radikal Sol AI şirketi" ilan ederek tüm federal kurumlarda Claude kullanımını yasakladı. Savunma Bakanlığı, Anthropic'i resmen "tedarik zinciri riski" olarak sınıflandırdı.

Ancak ironik bir şekilde, yasağın ardından saatler içinde başlayan İran operasyonunda Claude'un hâlâ kullanıldığı ortaya çıktı. Bu durum, AI teknolojisinin askeri kullanımında kimin son sözü söyleyeceği sorusunu gündeme getirdi. OpenAI'ın daha önce Pentagon ile yaptığı anlaşma da benzer bir etik tartışmayı alevlendirmişti; şimdi Anthropic olayı bu tartışmayı bambaşka bir boyuta taşıdı.

Shahed Drone'lar ve Maliyet Asimetrisi Tuzağı

İran'ın cevabı konvansiyonel füzelerden çok, düşük maliyetli drone'lara dayandı. ABD yetkilileri, İran'ın çatışma boyunca 2.000'den fazla drone fırlattığını açıkladı. Bunların büyük çoğunluğu, artık "yoksulun seyir füzesi" olarak anılan Shahed-136 kamikaze drone'larıydı.

Shahed-136'nın üretim maliyeti tahminen 20.000-50.000 dolar arasında. Buna karşılık bu drone'ları durdurmak için kullanılan Patriot veya THAAD füzelerinin tanesi milyonlarca dolara mal oluyor. Bu maliyet asimetrisi, İran'ın sayısal üstünlükle savunma sistemlerini zorlama stratejisinin temelini oluşturuyor.

Drone saldırılarının etkileri yıkıcı oldu:

- Katar'ın Ras Laffan LNG tesisi vurularak üretim durdu ve sevkiyatlarda mücbir sebep ilan edildi

- Suudi Arabistan'ın Ras Tanura rafinerisi, düşürülen drone kalıntılarının neden olduğu yangın sonrası kapatıldı

- Hürmüz Boğazı geçişleri fiilen durma noktasına geldi; Basra Körfezi'nde tankerlerde bekleyen 77 milyon varil petrol sıkıştı

- ABD'nin Riyad Büyükelçiliği drone saldırısına maruz kaldı

İran'ın bir diğer yeniliği ise insansız deniz araçlarıydı (kamikaze drone botları). Bu botlar, savaşın ilk başarılı deniz drone saldırısını gerçekleştirerek asimetrik savaşın denize de yayıldığını gösterdi.

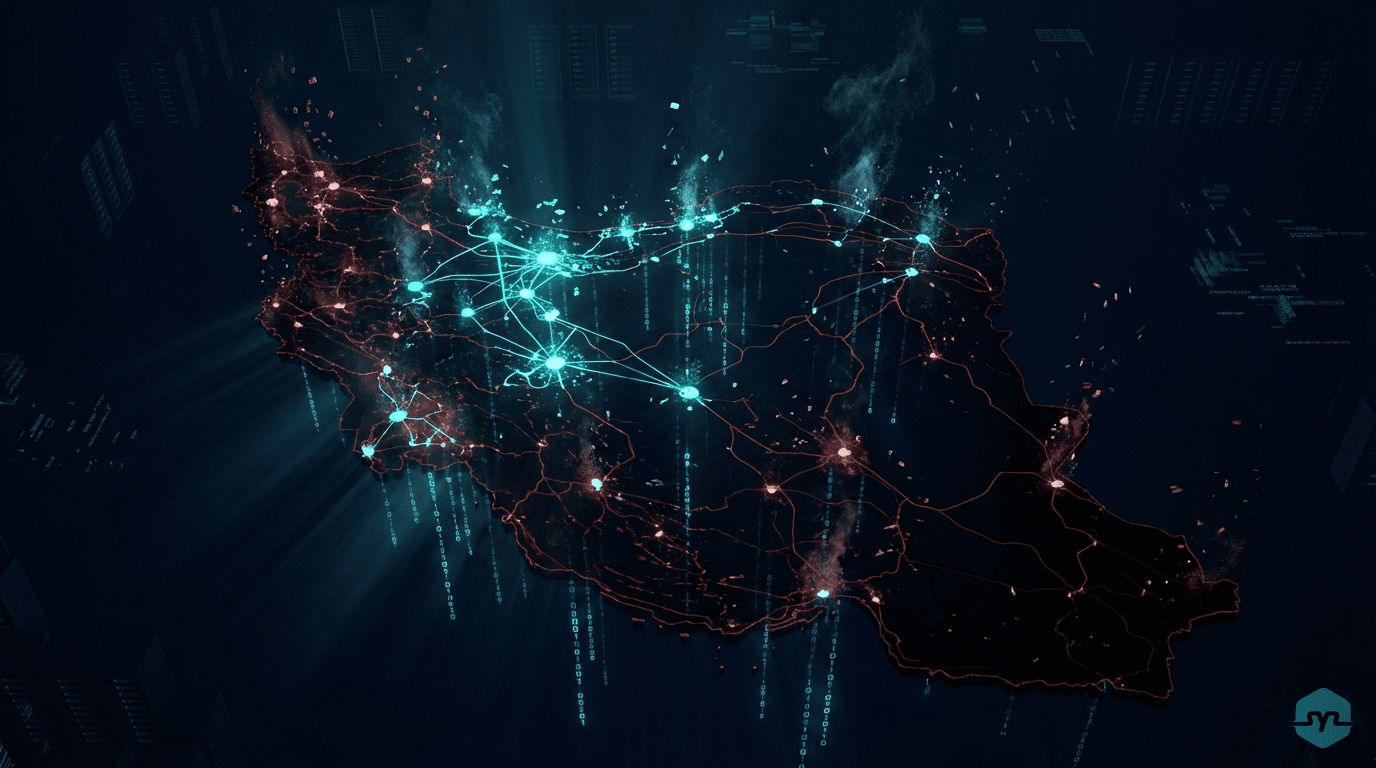

Tarihin En Büyük Siber Saldırısı İran'ı Karanlığa Gömdü

Fiziksel saldırılarla eşzamanlı olarak İsrail, tarihin en büyük koordineli siber saldırısını başlattı. NetBlocks'un verilerine göre İran'ın internet bağlantısı normal seviyenin yalnızca %4'üne düştü. Bu dijital karartma 60 saatten fazla sürdü.

Siber saldırının kapsamı inanılmaz genişti:

- Devlet haber ajansları IRNA ve Tasnim çökertildi; Tasnim'in sitesinde Hamaney karşıtı mesajlar yayınlandı

- BadeSaba Takvimi uygulaması (5 milyondan fazla indirme) ele geçirilerek askeri personele ve vatandaşlara "rejimden ayrılma" çağrısı yapan push bildirimleri gönderildi

- GPS ve otomatik tanımlama sistemleri bozularak Körfez bölgesinde 1.100'den fazla geminin navigasyonu etkilendi

- IRGC'nin iç iletişim altyapısı hedef alınarak karşı saldırı koordinasyonu engellendi

Batılı istihbarat kaynakları, bu siber operasyonun amacının İran'ın drone ve balistik füze fırlatma kapasitesini bozmak olduğunu belirtti. Yani siber saldırı, fiziksel saldırıları destekleyen stratejik bir silaha dönüştü.

Karşı tarafta ise İran destekli hacker grupları harekete geçti. CloudSEK'in raporuna göre 2 Mart itibarıyla 60'tan fazla bağımsız grup aktifti. Bu gruplar, İsrail ve Batılı hedeflere yönelik web sitesi ele geçirme ve kritik altyapı sabotajı girişimlerinde bulundu. Palo Alto Networks'ün Unit 42 birimi, Tahran bağlantılı hackerların ABD kritik altyapısına yönelik potansiyel siber saldırılar için dijital keşif faaliyetlerini artırdığı konusunda uyardı.

Teknoloji Şirketleri Safını Seçmek Zorunda Kalıyor

İran savaşı, teknoloji sektöründe derin bir ayrışmayı tetikledi. Anthropic'in Pentagon ile yaşadığı gerilimin ardından Google çalışanları, şirketin askeri AI kullanımına sınır koymasını talep eden açık mektuplar yayınladı. Google'ın Gemini modellerini gizli askeri ortamlara taşımak için Pentagon ile görüştüğü haberleri bu baskıyı artırdı.

Soru basit ama cevabı karmaşık: Yapay zeka şirketleri, teknolojilerinin savaşta nasıl kullanılacağı konusunda söz sahibi olmalı mı? Anthropic "evet" dedi ve bunun bedelini ödedi. Öte yandan savunma teknolojisi şirketleri, Pentagon'un Anthropic'i kara listeye almasının ardından Claude'dan uzaklaşmaya başladı.

Bu tartışma sadece ABD'yi ilgilendirmiyor. Yapay zekanın savaşta kullanımına dair uluslararası kurallar henüz yok. Rest of World'ün analizine göre AI ve drone teknolojisi, mevcut savaş hukuku kurallarının çok ötesine geçti. İnsani hesap verebilirliğin nasıl sağlanacağı, 2026'nın en acil uluslararası sorunlarından biri haline geldi.

Savaşın Teknolojik Dersleri

İran savaşının ilk haftası, modern savaşın geleceğine dair net sinyaller veriyor:

- Yapay zeka, savaşta "karar hızlandırıcı" rolüne geçti. İlk 24 saatte 1.000'den fazla hedefin vurulması, AI destekli istihbarat analizinin muazzam hızını gösteriyor.

- Drone'lar, konvansiyonel savaşın ekonomisini alt üst ediyor. 20.000 dolarlık bir Shahed ile milyonluk bir savunma füzesi arasındaki maliyet farkı sürdürülebilir değil.

- Siber savaş artık fiziksel saldırıların ayrılmaz parçası. İsrail'in İran'ı dijital karartmaya sokması, siber silahların stratejik etkisini kanıtladı.

- Teknoloji şirketleri ile devletler arasındaki güç mücadelesi kızışıyor. Anthropic olayı, AI geliştiren şirketlerin askeri kullanıma sınır koyma girişimlerinin siyasi bedeli olduğunu gösterdi.

- Uluslararası hukuk, teknolojinin gerisinde kaldı. Otonom hedef belirleme, drone sürüleri ve büyük ölçekli siber saldırılar için henüz net kurallar yok.

- Asimetrik savaş yeni bir boyut kazandı. Ucuz drone'lar, siber saldırılar ve AI araçları, askeri bütçesi küçük olan aktörlere bile orantısız etki yaratma kapasitesi sağlıyor.

Savaşın teknolojik boyutu, savunma sektörünün ötesinde her sektörü etkiliyor. Siber güvenlik artık sadece kurumsal veri koruma değil, ulusal güvenlik meselesi. Yapay zeka geliştiren her şirket, teknolojisinin nasıl kullanılabileceği sorusuyla yüzleşmek zorunda. Bu savaş, teknolojinin ne kadar güçlü bir silah olabileceğini — ve bu gücün kontrolünün ne kadar zor olduğunu — acı bir şekilde hatırlatıyor.