Kasım 2024'te Anthropic sessizce bir açık kaynak protokol yayınladı. Adı Model Context Protocol, kısaca MCP. Amacı basitti: yapay zeka modellerinin dış dünyayla konuşabilmesi için ortak bir dil oluşturmak. 18 ay sonra bu protokol 97 milyon kurulumu aştı, 10.000'den fazla aktif sunucuya ulaştı ve OpenAI'dan Google'a, Microsoft'tan Amazon'a kadar sektörün tüm büyük oyuncuları tarafından benimsendi.

Peki MCP tam olarak ne yapıyor, nasıl çalışıyor ve neden bu kadar hızlı yayıldı?

Yapay Zeka Modellerinin Entegrasyon Sorunu

Bir LLM (büyük dil modeli) ne kadar güçlü olursa olsun, tek başına yapabileceği şeyler sınırlı. Gerçek dünyada faydalı olabilmesi için veritabanlarına erişmesi, API'ler çağırması, dosya okuması ve harici araçları kullanması gerekiyor. Ancak her AI aracı bu entegrasyonları kendi yöntemiyle yapıyordu.

Sonuç ortada: N tane AI modeli ve M tane harici araç varsa, toplamda N×M ayrı entegrasyon gerekiyordu. Her yeni araç eklendiğinde tüm modeller için ayrı bağlantı kodu yazılıyordu. Bu durum hem geliştirme maliyetlerini artırıyor hem de bakım kabusuna dönüşüyordu.

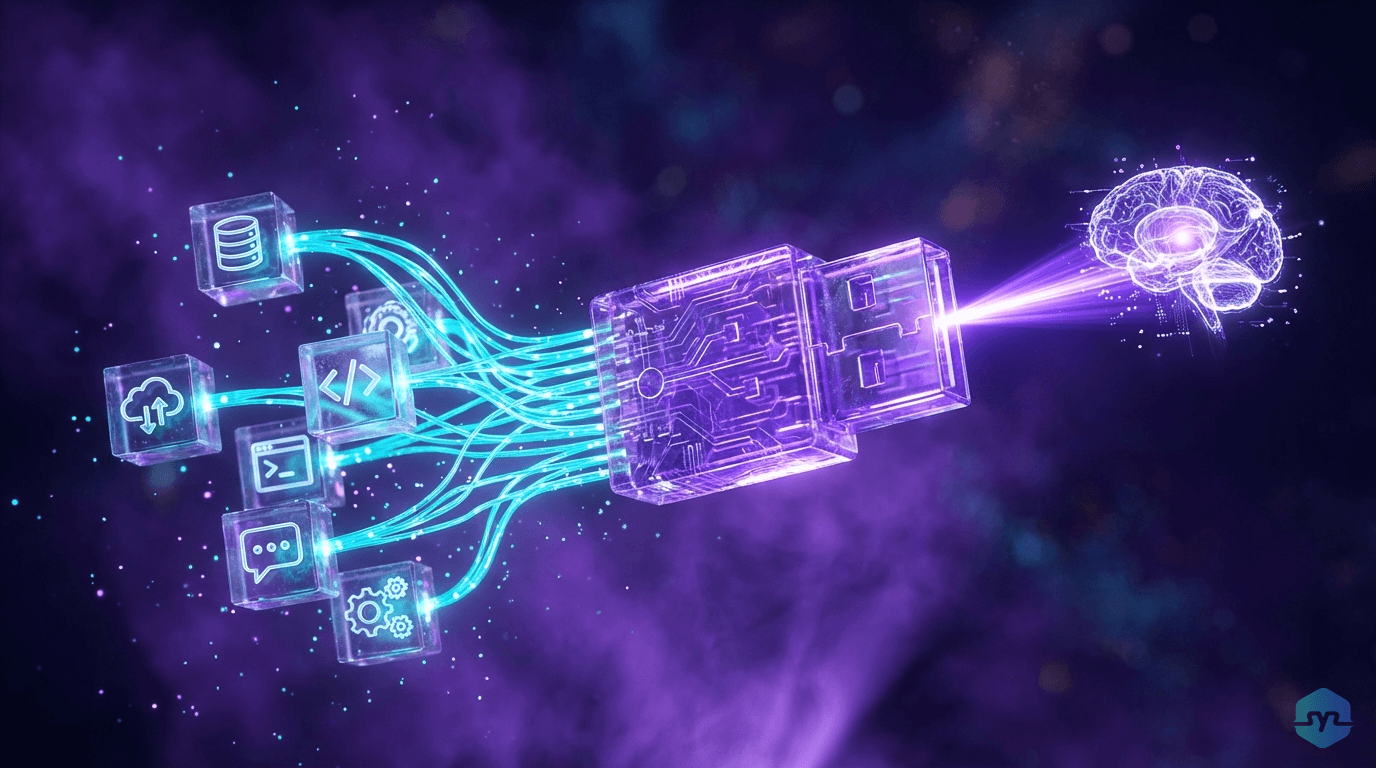

MCP bu N×M problemini N+M'ye indirgiyor. Nasıl ki USB standartı her cihaz için ayrı kablo tasarlama ihtiyacını ortadan kaldırdıysa, MCP de AI modelleri ile harici araçlar arasında evrensel bir bağlantı katmanı oluşturuyor.

MCP Nasıl Çalışıyor

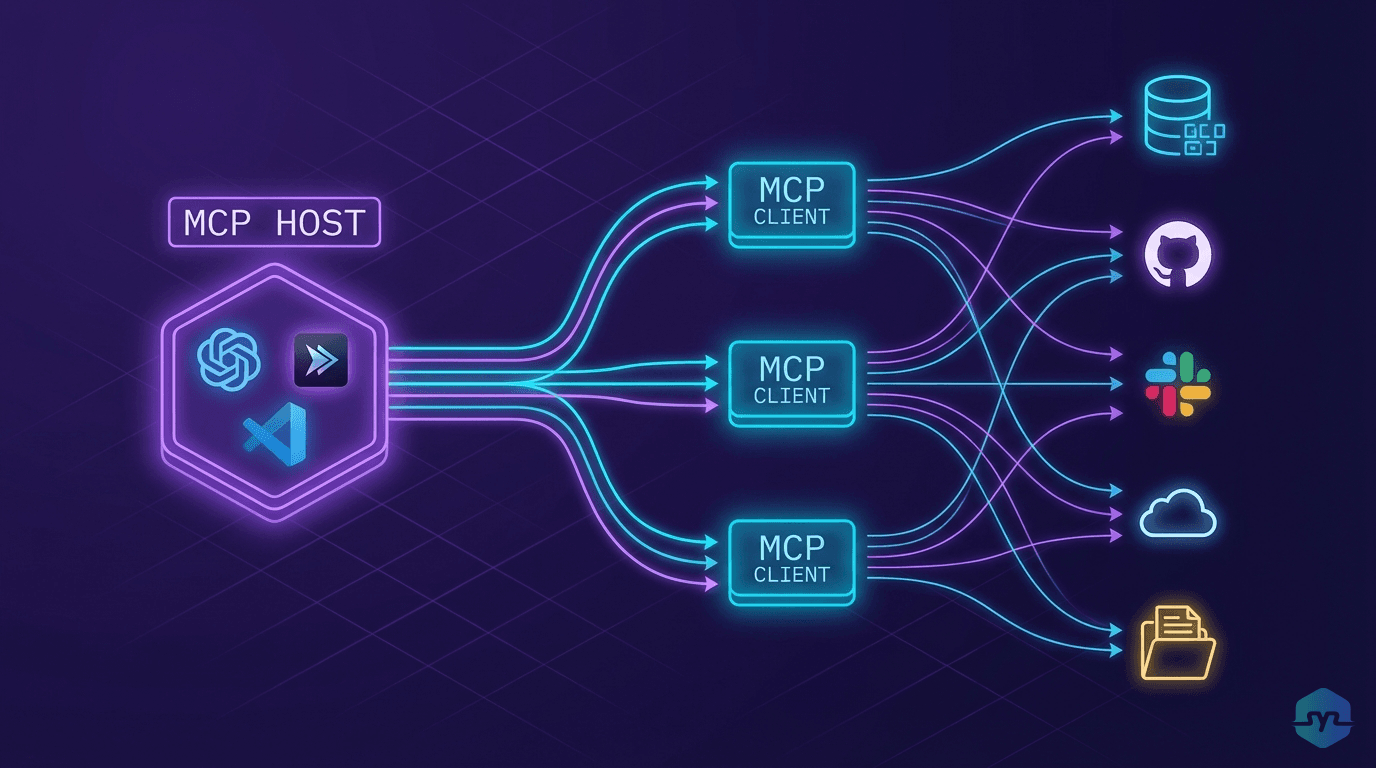

MCP, JSON-RPC 2.0 üzerine kurulu bir istemci-sunucu mimarisi kullanıyor. Üç temel bileşeni var:

MCP Host — Kullanıcının doğrudan etkileşimde olduğu uygulama. Claude Desktop, Cursor, VS Code Copilot gibi AI destekli araçlar birer MCP host'tur. Host, kullanıcının taleplerini alır ve arka planda MCP istemcileri oluşturur.

MCP Client — Host içinde çalışan ara katman. LLM ile MCP sunucusu arasındaki iletişimi yönetir. Sunucunun yeteneklerini keşfeder, LLM'in isteklerini sunucuya iletir ve yanıtları modelin anlayacağı formata çevirir.

MCP Server — Harici sistemlere bağlanan servis. Veritabanları, web servisleri, dosya sistemleri, üçüncü parti API'ler — her biri bir MCP sunucusu üzerinden AI modeline erişilebilir hale geliyor.

İletişim başladığında istemci ve sunucu bir el sıkışma (handshake) gerçekleştirir. Sunucu, sahip olduğu araçları (tools), kaynakları (resources) ve şablonları (prompts) istemciye bildirir. AI modeli bu listeyi görür ve ihtiyaç duyduğunda ilgili aracı çağırır.

Bu dinamik keşif mekanizması MCP'yi geleneksel API'lerden ayıran en kritik özellik. REST API'lerde entegrasyon önceden kodlanmalı ve endpoint'ler biliniyor olmalıdır. MCP'de ise AI modeli çalışma anında sunucunun neler yapabildiğini sorgulayıp kullanabiliyor.

Taşıma katmanında iki seçenek var: yerel sunucular için STDIO, uzak sunucular için Streamable HTTP. Bu esneklik, MCP'nin hem masaüstü uygulamalarında hem de kurumsal bulut ortamlarında çalışmasını sağlıyor.

MCP ve REST API Arasındaki Fark

MCP, REST API'nin yerini almıyor — onun üzerine AI dostu bir katman ekliyor. Temel farklar şöyle:

| Özellik | REST API | MCP |

|---|---|---|

| Tasarım amacı | Genel amaçlı veri alışverişi | AI modelleri için araç entegrasyonu |

| Keşif | Statik (dokümantasyon gerekli) | Dinamik (çalışma anında tools/list) |

| Entegrasyon maliyeti | Her model için ayrı kod | Bir kez yaz, her model kullansın |

| Bağlam yönetimi | Manuel | Protokol seviyesinde |

| Uygun olduğu yer | CRUD işlemleri, senkron istekler | Agentic AI, çok adımlı görevler |

Pratikte üç veya daha fazla AI entegrasyonu yöneten ekipler, MCP'nin karmaşıklığı belirgin şekilde azalttığını görüyor. Ancak basit CRUD operasyonları ve tek seferlik API çağrıları için REST hâlâ en pratik çözüm. Mevcut REST endpoint'lerinizi atmak yerine, MCP ile üzerine AI dostu bir katman eklemek en verimli yaklaşım.

Ekosistem: Kimler Kullanıyor

MCP'nin büyümesi rakamlarla daha iyi anlaşılıyor:

- 97 milyon+ aylık SDK indirmesi (Python ve TypeScript)

- 10.000+ aktif kamusal MCP sunucusu

- 34.700+ projede gömülü kullanım

- GitHub, Atlassian, Stripe, Sentry, Linear, Cloudflare ve Vercel'in resmi MCP sunucuları mevcut

Büyük AI sağlayıcılarının tümü MCP desteği sunuyor: Anthropic (Claude), OpenAI (ChatGPT), Google (Gemini), Microsoft (Copilot). Geliştirici araçları tarafında Cursor, Zed, Replit, Codeium ve Sourcegraph da ekosisteme dahil.

Yönetişim tarafında önemli bir gelişme yaşandı. Aralık 2025'te Anthropic, MCP'yi Linux Foundation bünyesindeki Agentic AI Foundation'a (AAIF) devretti. Kurucu üyeler arasında Anthropic, Block ve OpenAI yer alıyor; Google, Microsoft, AWS, Cloudflare ve Bloomberg destekçi olarak katıldı. Bu hamle, MCP'nin tek bir şirkete bağımlı olmadan HTTP veya USB gibi evrensel bir standart haline gelmesinin yolunu açtı.

İş Dünyasında MCP Ne Anlama Geliyor

MCP'nin kurumsal benimsenmesi 2026'da ciddi bir ivme kazandı. Araştırmalara göre MCP tabanlı entegrasyonlarda geliştirme süresi aylardan haftalara düşüyor ve entegrasyon maliyetlerinde %70'e varan azalma sağlanıyor. Bazı somut kullanım alanları:

Müşteri hizmetleri: AI chatbot'lar MCP üzerinden CRM, ödeme sistemi ve bilgi tabanına aynı anda erişerek müşteri sorularını tek seferde çözebiliyor.

Yazılım geliştirme: AI agent'lar MCP sunucuları aracılığıyla GitHub, Jira, veritabanı ve deployment pipeline'larını birlikte kullanarak geliştirme süreçlerini otomatikleştirebiliyor.

Veri analizi: Satış ekipleri doğal dil sorguları ile MCP üzerinden şirket verilerine erişirken, yetkilendirme katmanı her kullanıcının yalnızca kendi erişim hakları dahilindeki verileri görmesini sağlıyor.

RAG sistemleri: Bilgi tabanı çözümleri MCP ile birden fazla veri kaynağını tek bir protokol üzerinden bağlayarak daha zengin ve güncel yanıtlar üretebiliyor.

MCP'nin Geleceği

2026 yol haritasında güvenlik, kimlik doğrulama ve kurumsal uyumluluk öne çıkan temalar. Sağlık, finans ve üretim gibi düzenlenmiş sektörlerdeki talep, MCP'nin enterprise-ready olma sürecini hızlandırıyor.

Geliştiriciler için mesaj net: tıpkı on yıl önce her yazılım şirketinin bir REST API sunması gerektiği gibi, bugün her araç ve servis sağlayıcısının bir MCP sunucusu sunması bekleniyor.

Sonuç

- MCP, AI modellerinin harici araçlarla iletişim kurması için açık bir standart protokol

- N×M entegrasyon sorununu N+M'ye indirgiyor — USB'nin cihazlar için yaptığını AI için yapıyor

- 97 milyon kurulum ve 10.000+ sunucu ile en hızlı büyüyen AI altyapı standardı

- OpenAI, Google, Microsoft dahil tüm büyük oyuncular MCP desteği sunuyor

- Linux Foundation bünyesindeki AAIF'e devredilerek bağımsız yönetişim kazandı

- REST API'nin yerini almıyor, onun üzerine AI dostu bir katman ekliyor

- Kurumsal entegrasyon maliyetlerini %70'e kadar düşürebiliyor